Asistente de IA híbrido – Evolución de los agentes actuales

Escribí este artículo yo mismo y luego pedí a la IA que mejorara mi inglés.

Esta es mi opinión personal como arquitecto de soluciones, construyendo software en la nube y plataformas de datos durante 20 años. Es más bien una reflexión sobre cómo veo a Actor dentro de 1-2 años.

A medida que los asistentes de IA se vuelven más capaces, la arquitectura subyacente cobra tanta importancia como los propios modelos. Actualmente la evaluación de los agentes se basa en los modelos empleados, el framework y los prompts.

Para sistemas como Actor, diseñados para operar en correos electrónicos, calendarios, documentos y flujos de trabajo empresariales, un enfoque puramente en la nube o puramente local alcanza rápidamente sus límites.

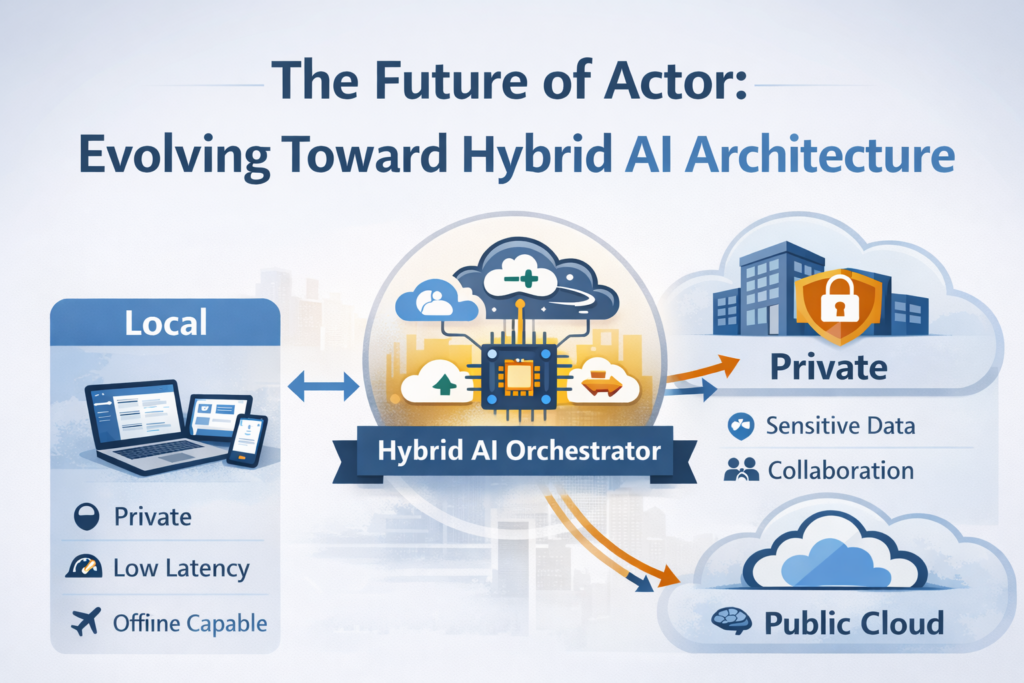

Lo que empieza a surgir en su lugar es una arquitectura híbrida, donde la inteligencia y la ejecución se distribuyen entre dispositivos locales, infraestructura privada y modelos en la nube.

Esto tiene menos que ver con una preferencia tecnológica y más con una necesidad arquitectónica.

Los límites de un asistente puramente en la nube

La mayoría de los asistentes de IA actuales operan principalmente en la nube. Esto tiene sentido al principio: los modelos son grandes, la infraestructura está centralizada y las actualizaciones son fáciles. Además, la inferencia es barata (o al menos para algunos modelos).

Pero una vez que un asistente se integra profundamente con los sistemas de trabajo, aparecen algunos problemas estructurales.

Primero, los límites de los datos importan.

Los asistentes de trabajo interactúan con información altamente sensible: documentos financieros, correos internos, contratos, hojas de ruta de producto, conversaciones de RR. HH. Muchas organizaciones no pueden legal ni operativamente transmitir estos datos de forma continua a infraestructura externa.

Entonces la conectividad se convierte en una dependencia.

Un asistente de trabajo que deja de funcionar en un avión, en un túnel de tren o durante problemas de red se vuelve poco fiable para las operaciones diarias.

La IA en la nube es poderosa, pero no puede manejar realísticamente todas las capas del sistema.

Los límites de un asistente puramente local

En el extremo opuesto, ejecutar todo localmente también se enfrenta a limitaciones importantes.

Los modelos de razonamiento más capaces aún requieren infraestructura de cómputo significativa. Mientras el hardware local mejora rápidamente —Apple Silicon, NPUs y chips de IA dedicados— ejecutar modelos de vanguardia para razonamiento complejo o síntesis de múltiples documentos sigue siendo impracticable en la mayoría de los dispositivos.

En segundo lugar, la latencia se acumula en flujos de trabajo de agentes.

Un asistente que realiza múltiples pasos como leer un correo, extraer tareas, comprobar el calendario, redactar una respuesta y programar seguimientos crea una cadena de llamadas a modelos e interacciones con API. Incluso pequeños retrasos se acumulan cuando las acciones son secuenciales.

También hay un reto de gobernanza.

Gestionar modelos en miles de dispositivos de empleados introduce complejidad operativa: actualizaciones, parches de seguridad, gestión de la configuración y supervisión del cumplimiento.

Finalmente, muchos flujos de trabajo del asistente requieren estado compartido.

Un cronograma del proyecto, una base de conocimientos del equipo o un sistema colaborativo de tareas no pueden residir completamente en el equipo de una sola persona.

La inteligencia local por sí sola tampoco puede ofrecer la imagen completa.

Una dirección probable: inteligencia distribuida

Una arquitectura más natural para asistentes como Actor es un modelo de inteligencia distribuida, donde diferentes capas del sistema se ejecutan en distintos entornos.

Un desglose simplificado podría verse así:

Capa local (entorno de ejecución del dispositivo)

Responsable de la percepción del entorno del usuario y de acciones rápidas.

Responsabilidades típicas:

- acceder a archivos, aplicaciones y notificaciones locales

- detectar señales contextuales (documentos activos, reuniones, correos electrónicos)

- ejecutar acciones rápidas y privadas

- almacenar en caché conocimientos usados con frecuencia

Infraestructura privada (nube de la organización o del usuario)

Responsable del estado compartido y del procesamiento de datos sensibles.

Responsabilidades típicas:

- bases de conocimiento de la empresa

- memoria compartida del agente

- contexto de colaboración del equipo

- procesamiento de documentos sensibles

Modelos de nube pública

Responsable de razonamiento intensivo y conocimiento a gran escala.

Responsabilidades típicas:

- tareas de razonamiento profundo

- síntesis compleja entre múltiples documentos

- recuperación de conocimiento a gran escala

- capacidades lingüísticas avanzadas

En este modelo, el el entorno de ejecución local actúa como orquestador, decidiendo dónde debe ejecutarse cada tarea.

La importancia del límite de confianza

Una de las decisiones de diseño más importantes pasa por definir la frontera de confianza.

En términos prácticos, esto implica responder preguntas como:

- ¿Qué datos nunca abandonan el dispositivo?

- ¿Qué datos pueden trasladarse a infraestructura privada?

- ¿Qué tareas pueden usar modelos externos con seguridad?

- ¿Cómo se registran y auditan estas decisiones?

Esta frontera se vuelve crítica para la adopción empresarial.

Las organizaciones no solo quieren capacidades de IA; también desean previsibilidad y control sobre dónde fluye la información.

Por qué es probable que esta arquitectura se convierta en estándar

Varias tendencias de la industria apuntan en esta dirección.

La aceleración por hardware está mejorando rápidamente en dispositivos locales, permitiendo modelos ligeros e inferencia local rápida.

Al mismo tiempo, las capacidades de los modelos de vanguardia siguen escalando en entornos en la nube, manteniendo una brecha que hace atractivo el razonamiento en la nube para tareas complejas.

Las empresas requieren cada vez más garantías de gobernanza de datos, empujando a los sistemas de IA hacia arquitecturas que puedan respetar los límites internos.

Finalmente, los marcos emergentes de agentes ya se basan en enrutamiento multimodelo, donde distintos modelos y entornos de ejecución se encargan de tareas diferentes.

Las arquitecturas híbridas se alinean de forma natural con este patrón.

Qué significa esto para Actor

Para Actor específicamente, una arquitectura híbrida podría desbloquear varias capacidades:

Un entorno de ejecución local podría comprender de forma continua el entorno del usuario, el contexto del correo, las reuniones y los documentos sin necesidad de transmitirlo todo externamente.

Una capa de infraestructura privada de Actor podría mantener memoria del usuario, grafos de tareas y contexto colaborativo.

Los modelos en la nube podrían invocarse selectivamente para tareas que realmente requieran razonamiento más profundo.

En lugar de un único punto final de IA, Actor se convierte en un sistema que coordina la inteligencia a través de capas.

Esta arquitectura también permite a usuarios y organizaciones elegir diferentes estrategias de despliegue según sus necesidades:

- nube personal

- infraestructura de la empresa

- híbrido local + nube

- despliegues totalmente privados

En otras palabras, Actor evoluciona de ser solo un asistente a convertirse en una capa cognitiva distribuida para el trabajo.

Mirando hacia el futuro

El futuro de los asistentes de trabajo probablemente no estará definido por un único modelo o proveedor.

En cambio, estará determinado por cómo se orquesta la inteligencia a través de los entornos.

Los sistemas que puedan combinar privacidad, rapidez de respuesta y un razonamiento potente tendrán una ventaja estructural.

Las arquitecturas híbridas parecen ser una de las vías más prometedoras para lograr ese equilibrio.

PD: Estoy reconstruyendo toda la arquitectura para estar listo para un modelo híbrido en un futuro próximo. Es mucho trabajo y llevará tiempo, pero es mi pasión.