ActorDo vs. autonome Agenten wie OpenClaw

KI-Agenten werden immer autonomer. OpenClaw (und seine Klone) ist das jüngste Auftreten von KI-Agenten, die Dinge für Sie erledigen.

Sie können E‑Mails senden, Dateien verschieben, Meetings buchen und Skripte ausführen.

Beeindruckend? Ja.

Sicher für Unternehmen? Nicht immer.

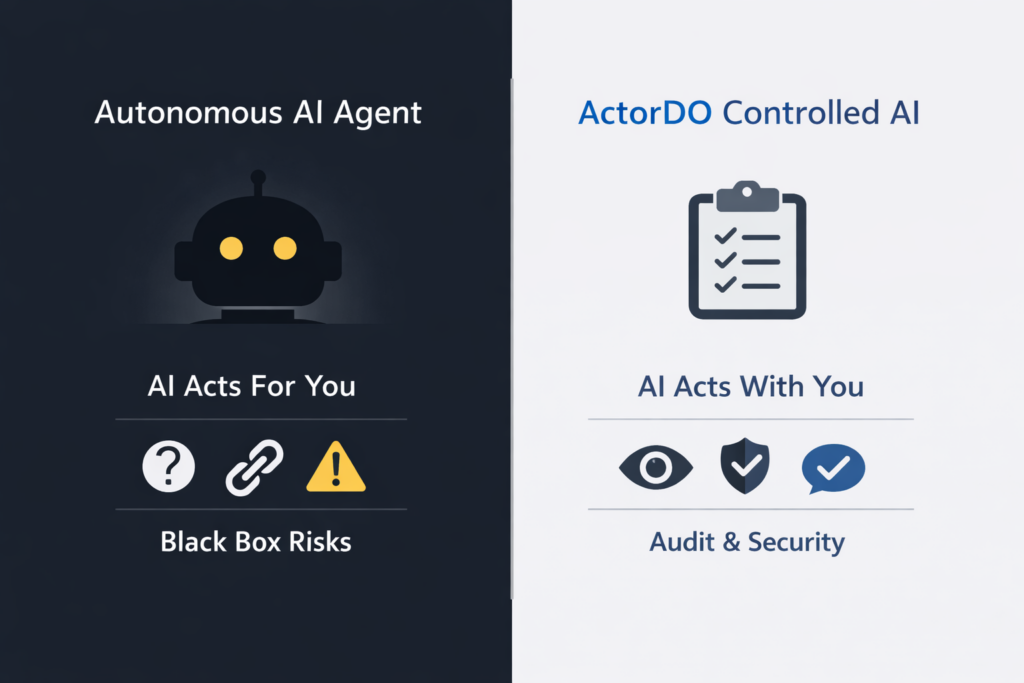

Es gibt einen grundlegenden Unterschied zwischen autonomen KI-Agenten wie OpenClaw und ActorDO.

Wir müssen jedoch zugeben, dass ein Werkzeug wie OpenClaw in Bezug auf Flexibilität, Erweiterbarkeit und die Fähigkeit, Dinge zu erledigen, die andere Assistenten nicht von Haus aus können, beeindruckend ist.

Und es lässt sich auf vier Aspekte reduzieren:

- Sicherheit

- Datenschutz

- Governance

- Geschäftskontrolle

- Kostenkontrolle

Lassen Sie es uns aufschlüsseln.

Sicherheit: Black Box vs. kontrollierte Ausführung

Autonome Agenten sind darauf ausgelegt, eigenständig zu handeln.

Sie gewähren Zugriff. Sie führen aus.

Das Problem?

- Sie können Aktionen automatisch auslösen

- Sie können umfangreiche Zugriffsumfänge haben

- Sie können Folgeentscheidungen treffen, die Sie nicht ausdrücklich genehmigt haben

In geschäftlichen Umgebungen ist das riskant.

ActorDo verfolgt einen anderen Ansatz:

- Klare Ausführungsgrenzen

- Aktionsprotokolle

- Kontrollierte Bereiche

- Menschliche Genehmigung, wo erforderlich

- Keine versteckten Automatisierungsketten

Es ist nicht „aus dem Ruder laufende KI“, sondern KI, die innerhalb eines kontrollierten Systems agiert.

Privatsphäre: Datenhoheit ist entscheidend

Viele autonome Werkzeuge erfordern:

- Voller Zugriff auf den Posteingang

- Vollständige Dateisystemberechtigungen

- Externes Hosting sensibler Daten

- Weitreichende API-Schlüssel

ActorDO ist nach dem Prinzip „Datenschutz zuerst“ aufgebaut:

- Gezielte Integrationen (Google, Microsoft usw.)

- Klare Daten-Trennung pro Nutzer

- Kontrollierte Speicherarchitektur

- Entwickelt für regulierte Regionen und Compliance-Kontexte

- Kein verstecktes Scraping oder unkontrolliertes Crawling

Im Geschäftsleben ist Datenschutz kein Feature, sondern muss Teil der Infrastruktur sein.

Governance: Beobachtbarkeit und Prüfbarkeit

Hier zeigt sich der eigentliche Unterschied. Autonome Agenten optimieren darauf, „Dinge zu erledigen“.

ActorDO optimiert für:

- Beobachtbarkeit (Sie sehen, was passiert ist)

- Prüfpfad (wer was, wann und warum getan hat)

- Ausführungsprotokolle

- Aktionsverlauf

- Fehlerrückverfolgbarkeit

- Berechtigungsebenen

Sie können:

- Entscheidungen prüfen

- KI-generierte Aktionen überprüfen

- Überschreiben

- Korrigieren

- Ausführung stoppen

Das ist entscheidend für:

- Finanzteams

- Unternehmensumgebungen

- stark regulierte Branchen

- wachsende Startups

KI ohne Governance wird zum Haftungsrisiko.

ActorDO ist aufgebaut als gesteuertes KI-System, nicht als frei agierender Agent.

Geschäftlicher Fokus: Produktivität, nicht Experimentieren

Viele offene KI-Agenten sind allgemein einsetzbar und beeindruckende Ingenieursprojekte.

Aber Unternehmen brauchen keine Experimente.

Sie benötigen:

- strukturierte E-Mail-Workflows

- Follow-up-Management

- Aufgabenextraktion

- Kalenderintelligenz

- vorhersehbare Automatisierung

- klarer ROI

ActorDO konzentriert sich auf:

- Klarheit im Posteingang

- Aktionsextraktion

- Workflow-Automatisierung

- Professionelle Produktivität

Keine Manipulation des Systems.

Kein zufälliges Surfen im Web.

Keine Ausführung von Shell-Befehlen.

Es ist KI, die für professionelle Abläufe entwickelt wurde.

Autonomie vs. Kontrolle

Autonome KI: „Ich übernehme alles.“

ActorDO: „Lassen Sie es uns gemeinsam – transparent – angehen.“

Das ist ein grundlegender philosophischer Unterschied.

ActorDO ist:

- Kontrolle zuerst

- Sicherheit zuerst

- Governance-bereit

- Geschäftsorientiert

Es geht nicht darum, menschliches Urteilsvermögen zu ersetzen. Sondern darum, es sicher zu erweitern.

Warum das 2026 und darüber hinaus wichtig ist

KI wird immer leistungsfähiger. Das wissen wir bei Actor und wir planen dafür.

Was bedeutet:

- Die Angriffsfläche nimmt zu

- Compliance-Anforderungen steigen

- Die Sensitivität der Daten nimmt zu

- Die operative Komplexität nimmt zu

Unternehmen werden nicht die am meisten autonome KI wählen. Sie werden die KI wählen, die sie kontrollieren können:

- Vertrauen

- Prüfung

- Kontrolle

- Erklären

Das ist der Unterschied. Und dafür steht ActorDO.

Vollständiger Vergleich zwischen ActorDo und autonomen KI-Agenten

| Dimension | Autonome KI-Agenten | ActorDO |

|---|---|---|

| Grundphilosophie | Autonomie zuerst („KI handelt für Sie“) | Kontrolle zuerst („KI handelt mit Ihnen“) |

| Hauptziel | Aufgaben eigenständig ausführen | Professionelle Arbeitsabläufe unterstützen |

| Entscheidungsmodell | Selbstgesteuerte Verkettung von Aktionen | Strukturierte, begrenzte Ausführung |

| Transparenz der Ausführung | Oft undurchsichtig oder unvollständig | Volle Transparenz der Aktionen |

| Beobachtbarkeit | Eingeschränkte oder technische Protokolle | Strukturierte Protokolle, Aktionsverlauf, Rückverfolgbarkeit |

| Prüfpfad | Nicht immer für den Geschäftsbetrieb geeignet | Für Prüfbarkeit konzipiert |

| Mensch im Prozess | Fakultativ / minimal | Eingebaute Steuerungs- und Prüfungsebene |

| Überschreibungsfunktion | Schwer rückgängig zu machen, sobald ausgelöst | Einfach zu prüfen, zu ändern und zu stoppen |

| Berechtigungsverwaltung | Breiter System-/API-Zugriff | Begrenzte Integrationen und kontrollierte Zugriffsbereiche |

| Sicherheitsmodell | Leistungsstark, aber mit größerer Angriffsfläche | Design mit minimalem Ausbreitungsradius |

| Datenschutzarchitektur | Oft zentralisiert oder experimentell | Isolation auf Nutzer-Ebene und strukturierte Datenabgrenzungen |

| Compliance-Bereitschaft | Selten unternehmensreif | Für Geschäftskontexte in EU und Schweiz konzipiert |

| Daten-Governance | Schwache Durchsetzung von Richtlinien | Strukturierte Governance-Ebene |

| Rollenbasierter Zugriff | Selten | Kann auf Geschäftsrollen ausgelegt werden |

| Fehlerbehandlung | Autonome Wiederholungen / Kettenverhalten | Transparenter Fehlerfall & Überprüfung |

| Erklärbarkeit | Kann ohne klare Erklärung handeln | Nachvollziehbare Aktionen & Entscheidungswege |

| Berechenbarkeit | Kann emergent/unerwartet sein | Deterministische Arbeitsabläufe |

| Komplexität der Einrichtung | Technisch & experimentell | Geschäftsorientiertes Onboarding |

| Zielgruppe | Entwickler, KI-Enthusiasten | Fachleute, Gründer, Teams |

| Geschäftsorientierung | Allgemein einsetzbar | E-Mail, Aufgaben, Workflow-Produktivität |

| Risikoprofil | Höher (große Autonomie) | Kontrolliert und begrenzt |

| Skalierbarkeit in der Organisation | Schwerer zu standardisieren | Für die Einführung im Team strukturiert |

| Vertrauensfaktor | „Hoffentlich funktioniert es“ | „Überprüfen, was passiert ist“ |

| Langfristige Wartbarkeit | Experimentelle Weiterentwicklung | Produktorientierte Roadmap |

| Einsatz in Finanz- und Compliance-Branchen | Riskant | Besser geeignet |

| Integrationsphilosophie | Tiefgehende Kontrolle auf Systemebene | Gesteuerte SaaS-/API-Integrationen |

| Auswirkung bei Ausfall | Kann sich kaskadierend auswirken | Gekapselte Ausführung |

| Bereitschaft für Unternehmenseinsatz | Gering | Mittel → Hoch (abhängig von der Reife der Implementierung) |

Zukünftige Pläne für ActorDo.

ActorDo ist nicht gegen Autonomie und wir arbeiten an der Zukunft.

Die Richtung ist klar: Das System wird autonomer, flexibler und zunehmend in der Lage sein, mehrstufige Workflows eigenständig zu bearbeiten.

Autonomie wird die Governance jedoch nicht ersetzen. Während sich ActorDo weiterentwickelt, wird es beibehalten:

- Beobachtbarkeit

- Audit-Protokolle

- Eingeschränkte Berechtigungen

- Manuelle Übersteuerung

- Klare Ausführungsgrenzen

Das Ziel ist nicht, den Menschen aus der Schleife zu entfernen. Es geht darum, Reibung zu verringern und gleichzeitig die Kontrolle zu erhalten.

Mit anderen Worten:

Mehr Intelligenz und mehr Automatisierung.

Gleiche Transparenz. Gleiche Governance. Gleiche geschäftsreife Sicherheit.

Dieses Gleichgewicht ist die langfristige Vision.